Introduction Long Short Term Memory Network

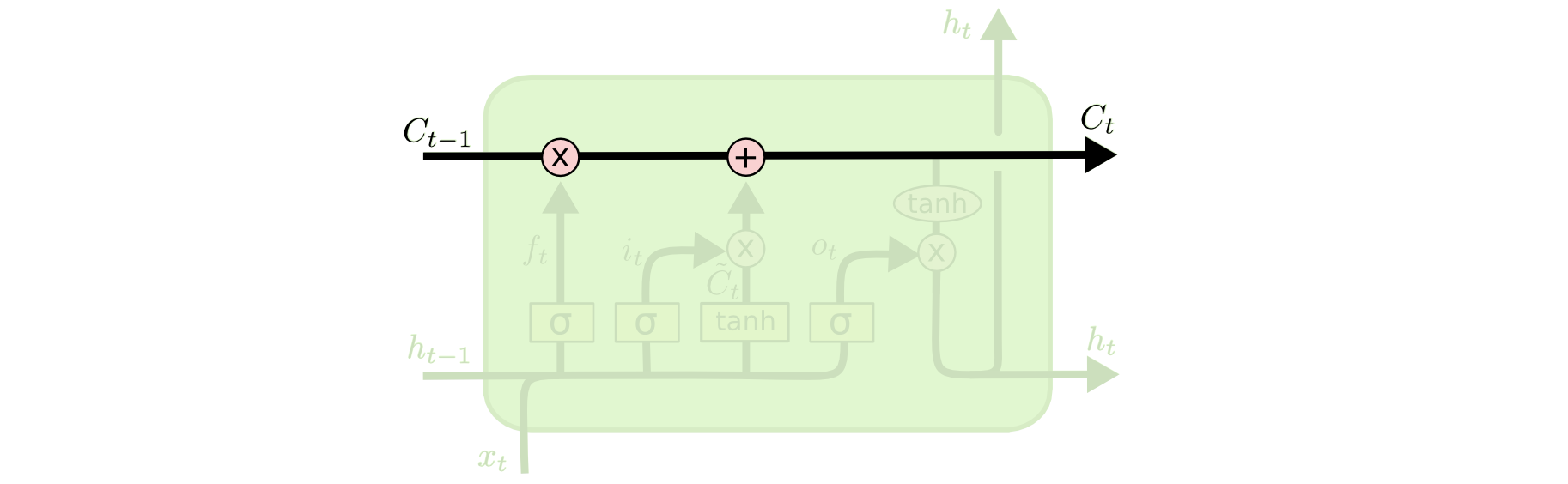

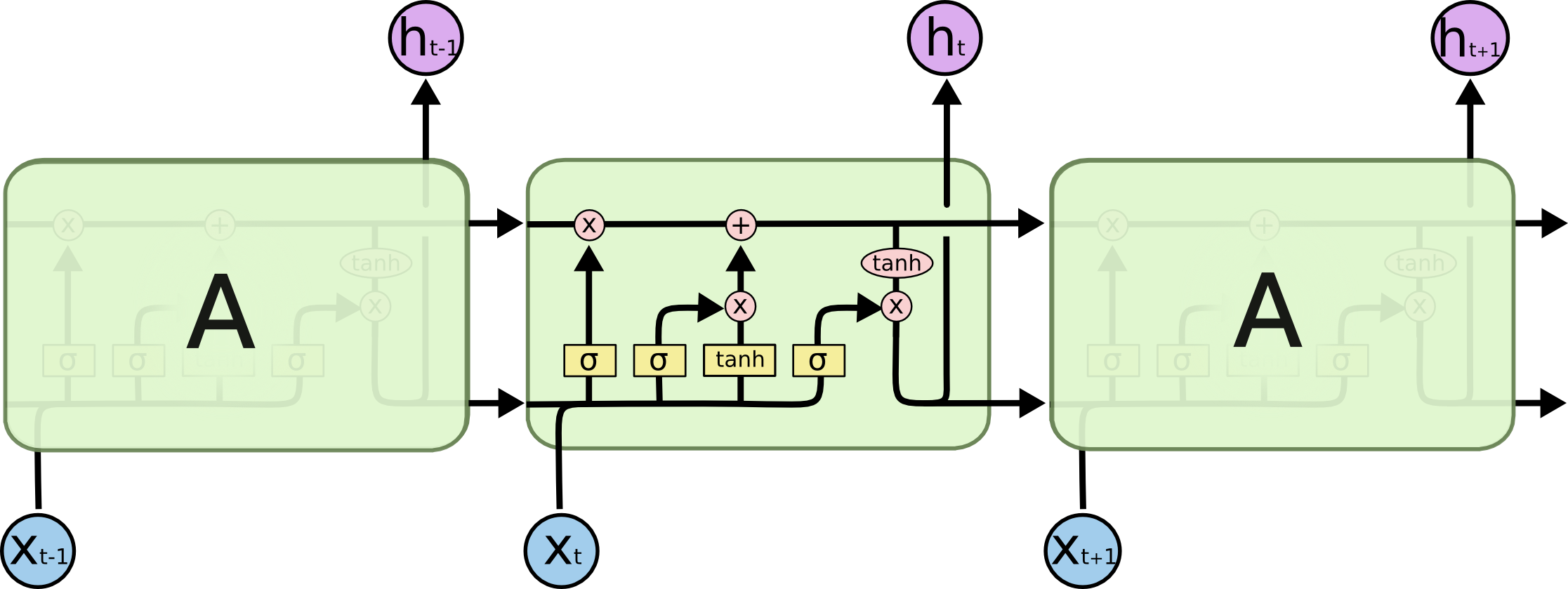

与传统的RNN相比,LSTM多出一个细胞状态链用于存储细胞状态,LSTM中包含了Gate的概念,新增3个门来控制细胞状态,包括遗忘门(Forget Gate)、输入门(Input Gate)、输出门(Output Gate)

-

LSTM 多出一个Cell状态链

-

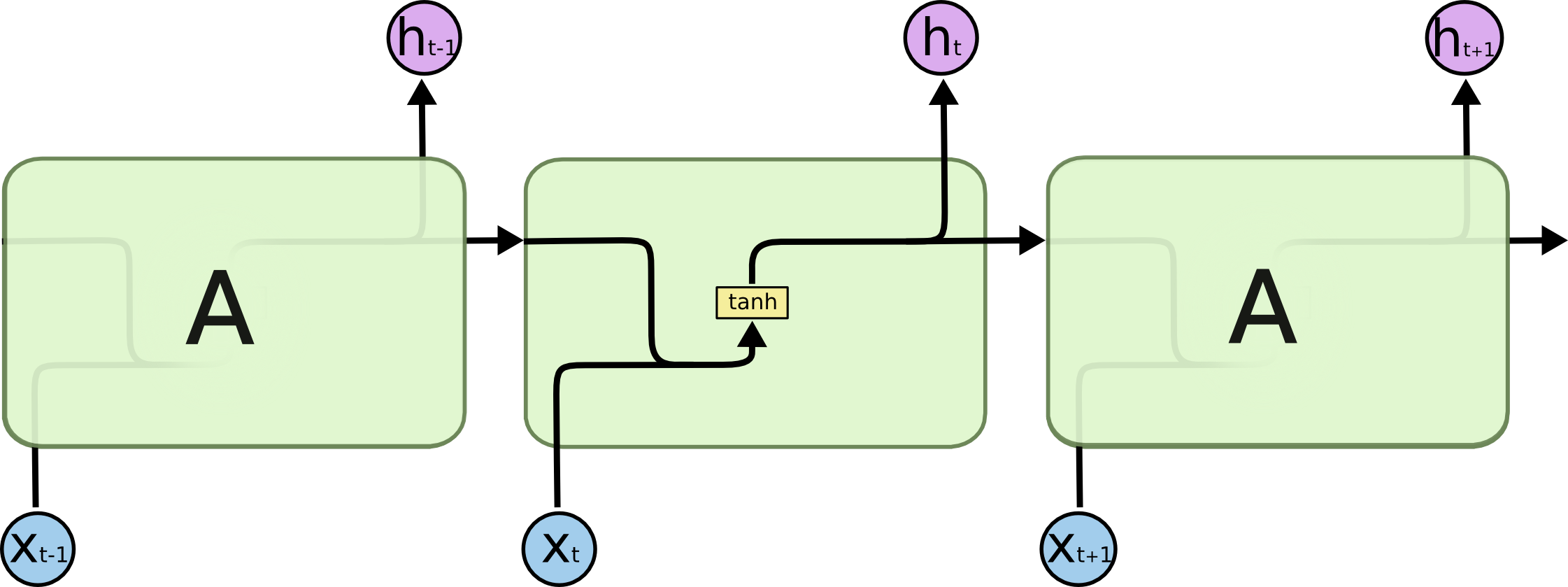

传统的RNN只包含一tanh层

- LSTM 含有四个交互层

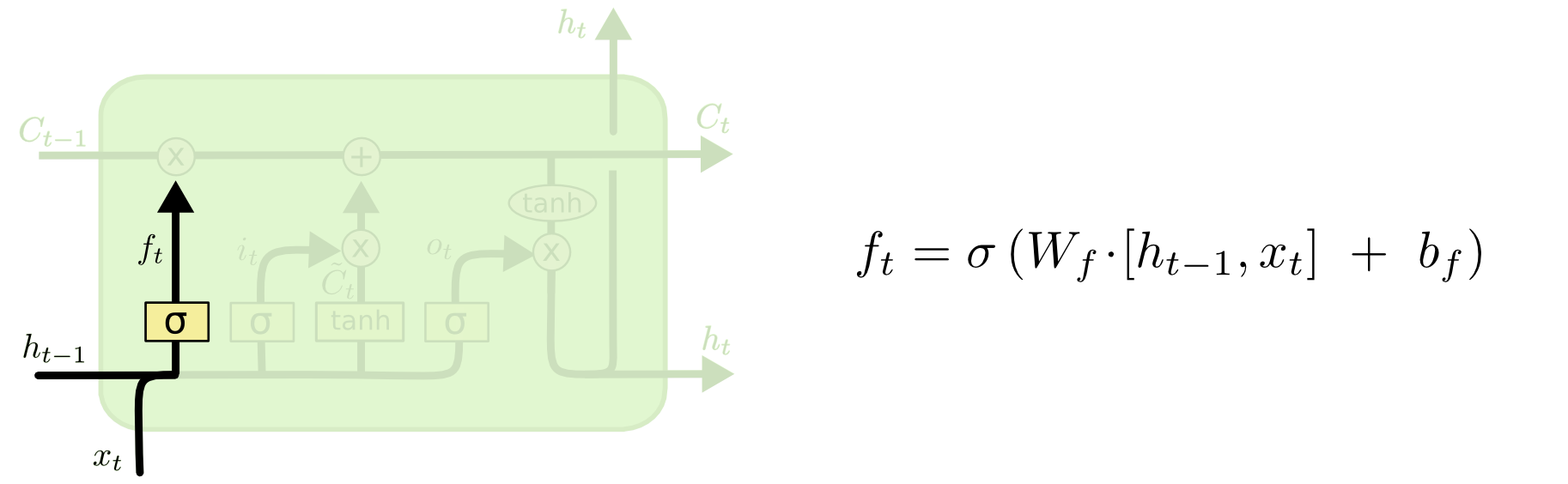

- Forget Gate 控制丢弃的信息

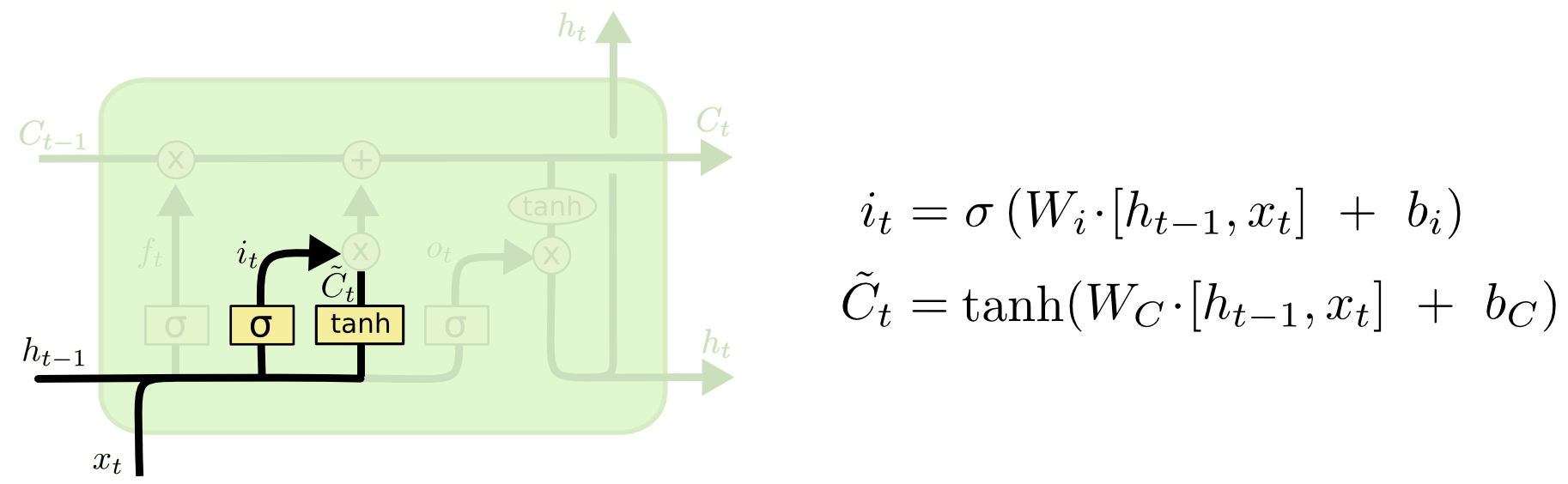

- Input Gate 控制更新的信息

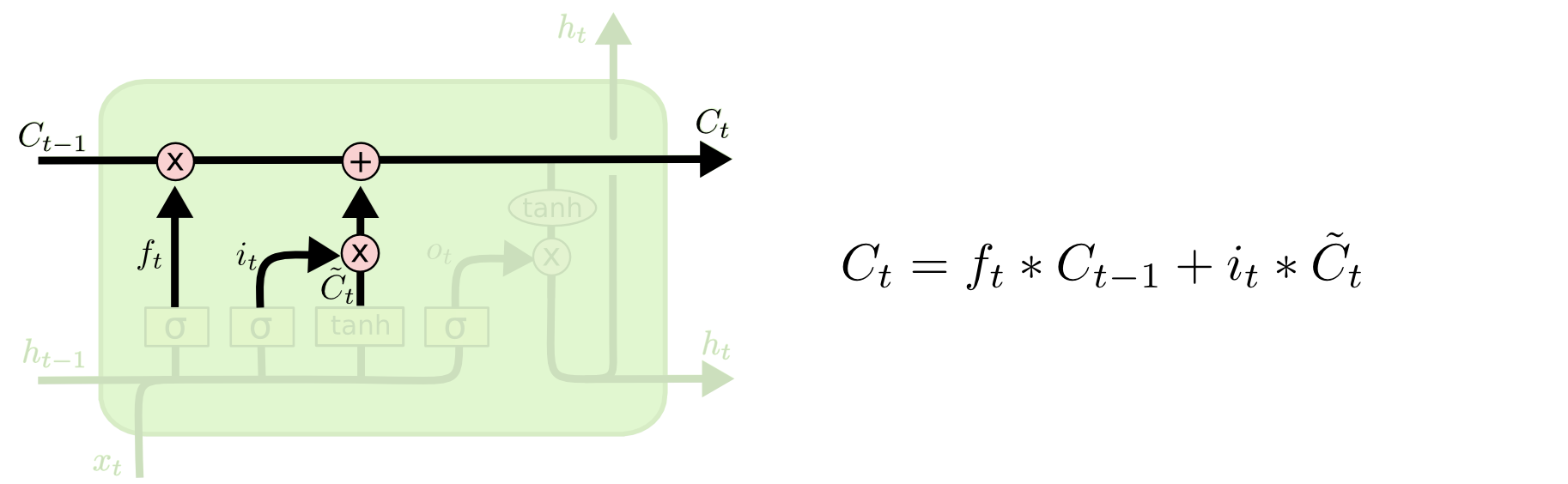

- 更新细胞状态

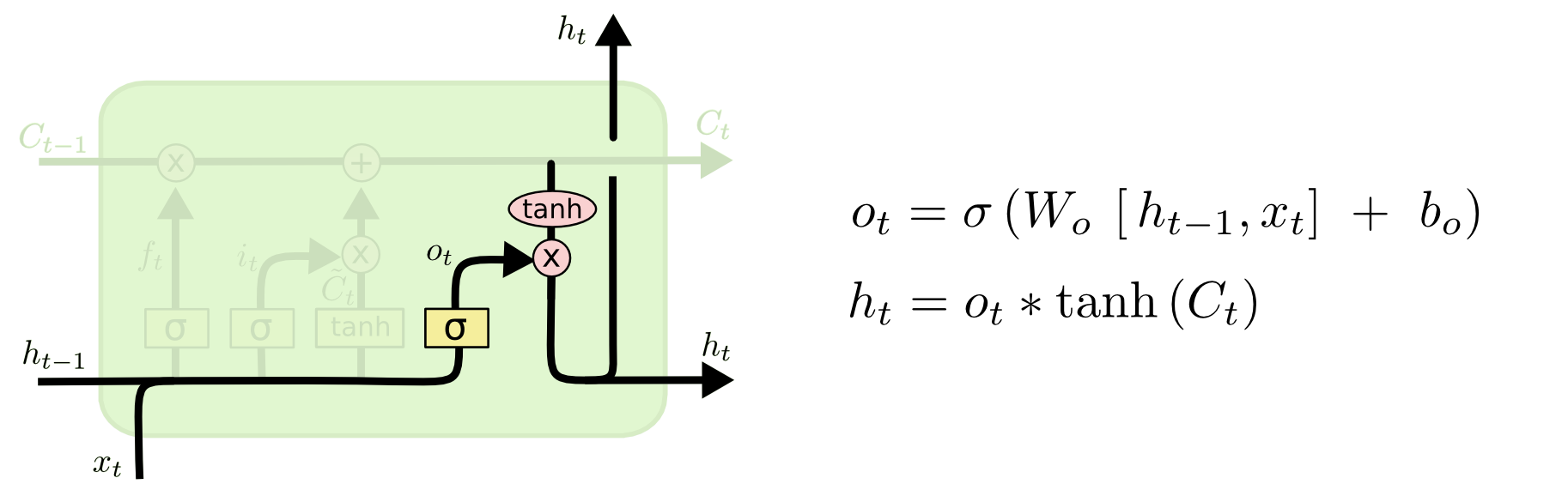

- Output Gate控制输出的信息

Train LSTM

- 向前计算每个神经单元的值,包括$\mathbf{f}_t$、$\mathbf{i}_t$、$\mathbf{c}_t$、$\mathbf{o}_t$、$\mathbf{h}_t$

- 反向计算每个神经元的误差$\delta$

- 计算每个权重的梯度

Define Value

- 定义t时刻的误差

- 定义各层的值和误差项

Calculate $\mathbf{ \Large { \frac{\partial{E}}{\partial{w}}} }$

- $\delta_j^t=\frac{\partial{E}}{\partial{net_j^t}}$ (refrence Calculate $\mathbf{ \delta_k^T }$)

- $h_i^{t-1} =\frac{\partial{net_j^t}}{\partial{w_{ji}}}$